L’intelligenza artificiale è ormai entrata nel linguaggio quotidiano, nelle organizzazioni, nella scuola, nel lavoro e persino nelle nostre conversazioni più ordinarie. Ma che cosa stiamo davvero nominando quando parliamo di intelligenza artificiale? E soprattutto: quale rapporto esiste tra intelligenza artificiale, etica, impresa, giustizia e pace?

Queste domande sono al centro di una riflessione urgente. Non si tratta soltanto di capire come funzionano i modelli linguistici o i sistemi generativi. Si tratta di comprendere quale tipo di civiltà stiamo costruendo. In dialogo con Navid Pourmokhtari, il dott. Farzin Aghdasi, il dott. Doug Allen e la prof.ssa Cindi Fukami offrono una prospettiva ricca, concreta e profondamente umana: la tecnologia non decide da sola il nostro futuro. Lo amplifica.

Da una prospettiva Bahá’í, questo punto è decisivo. Gli strumenti possono moltiplicare la capacità umana, ma non sostituiscono la trasformazione del cuore, la consultazione, la giustizia o la responsabilità morale. Se l’intelligenza artificiale deve servire il bene comune, allora il centro della conversazione non può essere soltanto la prestazione tecnica. Deve essere anche il fine spirituale e sociale verso cui orientiamo tale potenza.

Per facilitare la comprensione di questi contenuti anche a chi non possiede conoscenze tecniche o non ha familiarità con la lingua inglese, è stata realizzata una video sintesi automatizzata in italiano dell’intervista originale. Questa versione semplificata permette di cogliere i punti essenziali del dialogo e di avvicinarsi con maggiore immediatezza a un tema complesso e di grande attualità.

Definizione di AI

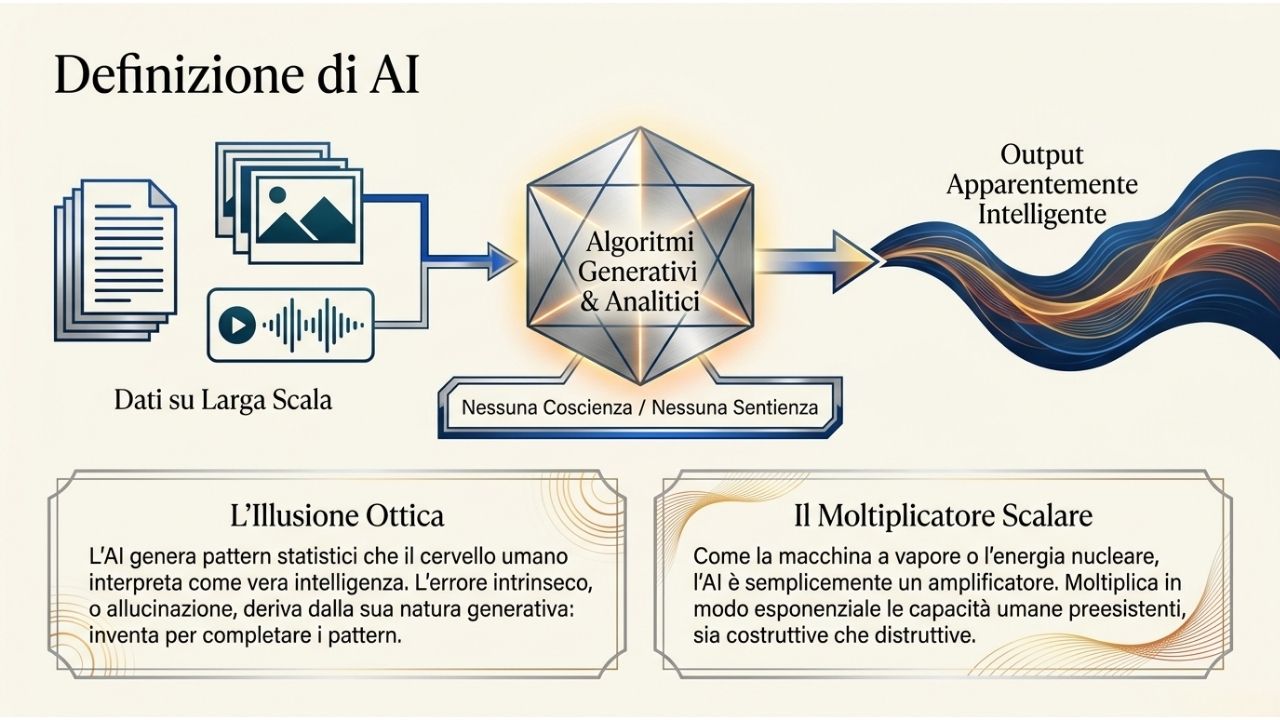

Per affrontare seriamente il tema dell’intelligenza artificiale, conviene cominciare da una definizione sobria. Il termine ha una storia lunga decenni, ma per molto tempo è rimasto confinato ai laboratori, alla ricerca sperimentale e a casi d’uso limitati. Negli ultimi anni, invece, l’intelligenza artificiale è diventata improvvisamente popolare grazie alla diffusione dei grandi modelli linguistici e di strumenti capaci di generare testo, immagini, suoni e risposte in forma conversazionale.

Farzin Aghdasi ricorda un punto essenziale: ciò che chiamiamo intelligenza artificiale non è una mente cosciente. Non è senziente, non comprende nel senso umano del termine, non possiede saggezza. Produce output che appaiono intelligenti agli esseri umani. È una distinzione importante, e oggi più che mai necessaria.

“La macchina in sé non è senziente. Non ha comprensione, non ha saggezza, ma è capace di generare risposte che agli esseri umani appaiono intelligenti.”

Questa osservazione aiuta a fare chiarezza. L’intelligenza artificiale include sia capacità analitiche, cioè la lettura e l’interpretazione di input come testi, immagini o audio, sia capacità generative, cioè la produzione di nuovi contenuti. Un sistema può ricevere una richiesta come “disegnami un paesaggio con un albero, un fiume e un cavallo” e creare un’immagine fotorealistica indistinguibile, per molti, da una fotografia reale. Può ascoltare una domanda in linguaggio naturale e restituire una risposta fluida e plausibile. Può sintetizzare, classificare, tradurre, riassumere, imitare stili, formulare ipotesi.

Schema visivo del funzionamento dell’intelligenza artificiale che evidenzia l’assenza di coscienza e il suo ruolo come amplificatore delle capacità umane

Ma il carattere persuasivo del risultato non equivale alla verità. Qui emerge un altro punto fondamentale sollevato nel dialogo: la cosiddetta “allucinazione” dei sistemi generativi non è un incidente marginale, bensì una conseguenza del loro stesso funzionamento. Aghdasi lo esprime con ironia: se il nome è “generative AI”, allora bisogna ricordare che “generate” significa anche inventare, creare materiale nuovo, talvolta perfino inventare ciò che non esiste.

Per questo l’intelligenza artificiale va compresa come un insieme di costrutti algoritmici e informatici capaci di elaborare dati su vasta scala e di restituire risultati utili, potenti e spesso sorprendenti, ma non autosufficienti. Serve supervisione umana. Serve verifica. Serve discernimento.

Il rischio più grande, infatti, non è soltanto che la tecnologia sbagli. È che gli esseri umani comincino a trattarla come se non sbagliasse, o peggio ancora come se potesse sostituire il giudizio umano. Da qui prende avvio tutta la questione etica.

Impatto e Sfide Etiche

L’intelligenza artificiale ha un impatto trasversale, perché opera come moltiplicatore di scala. Può analizzare enormi quantità di dati, riconoscere pattern difficili da individuare per una singola mente umana e accelerare processi che fino a ieri richiedevano mesi o anni. Questo la rende uno strumento straordinariamente promettente. Ma rende anche enormemente più rapidi e potenti gli usi distorti.

Doug Allen insiste su questa ambivalenza. L’intelligenza artificiale può aiutarci a esplorare fenomeni globali complessi, a individuare tendenze, a raccogliere prospettive da un gran numero di persone e a portare alla luce schemi che altrimenti ci sfuggirebbero. Tuttavia, il fatto che un sistema trovi un pattern non significa che quel pattern debba essere accettato come verità. Il risultato va trattato come input, non come sentenza finale. Va replicato, verificato, contestualizzato.

Questa distinzione tra supporto e autorità è al cuore delle sfide etiche. La stessa capacità di scalare che permette applicazioni benefiche consente anche danni massivi. Un esempio citato è l’aumento impressionante del phishing dopo l’arrivo dei sistemi conversazionali avanzati. Se un truffatore può produrre in pochi minuti migliaia di messaggi credibili, personalizzati e grammaticalmente impeccabili, allora il danno si espande con una velocità nuova.

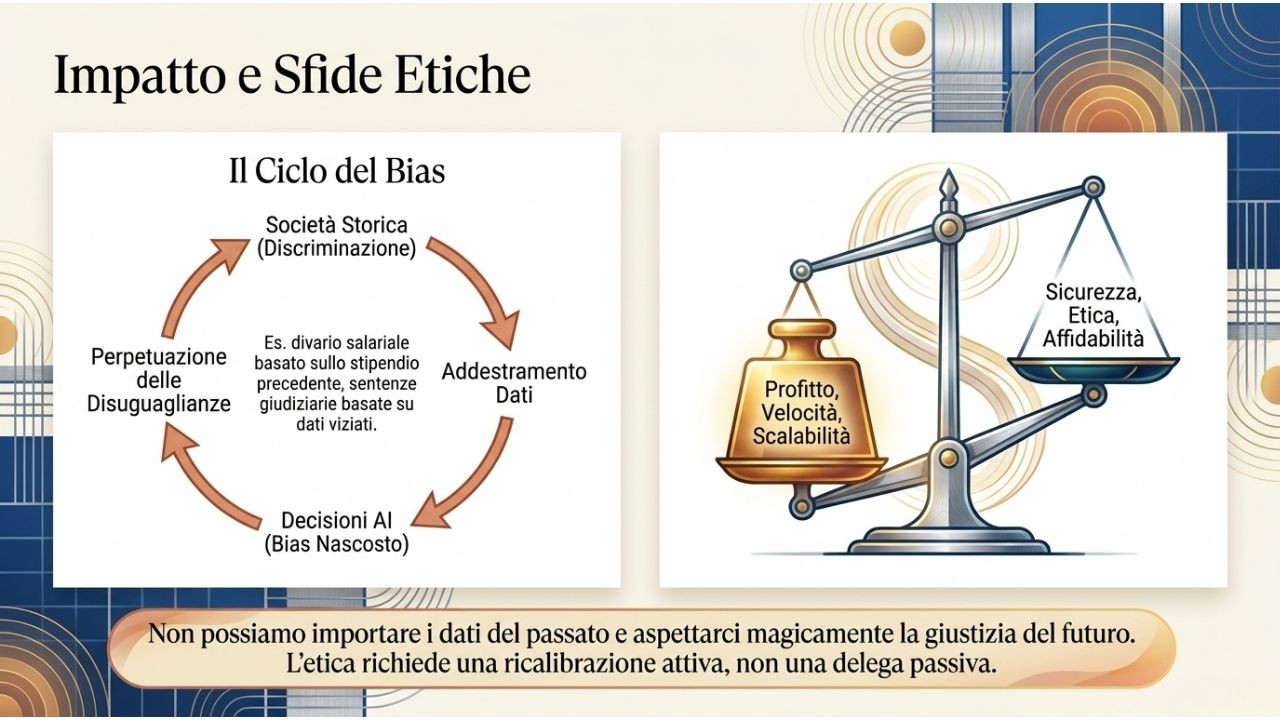

Visualizzazione del ciclo del bias e del delicato equilibrio tra profitto e responsabilità etica nell’uso dell’intelligenza artificiale

Non è dunque corretto dire che il male sia “dentro” la tecnologia come destino inevitabile. Più corretto è dire che la possibilità di impieghi molto diversi è incorporata nella sua struttura. L’esito dipende dalle scelte umane, dalle istituzioni, dai modelli economici e dai valori che governano lo sviluppo.

Su questo punto Allen è molto diretto: il mercato ha spinto con forza verso ciò che è redditizio, veloce e scalabile, ma non ha investito in modo simmetrico nella sicurezza, nell’affidabilità e nelle conseguenze etiche di secondo e terzo ordine. È una critica importante. Non implica che tutte le aziende siano malintenzionate, ma che l’ecosistema complessivo ha privilegiato l’accelerazione rispetto alla responsabilità.

Tra le sfide etiche più serie compare il problema del bias. I sistemi di intelligenza artificiale vengono addestrati su enormi masse di dati storici. E la storia umana non è neutrale. È piena di disuguaglianze, discriminazioni, asimmetrie di potere. Se addestriamo macchine su dati prodotti da società ingiuste, rischiamo di automatizzare l’ingiustizia.

Allen racconta un esempio molto concreto, non legato in origine all’AI ma illuminante per capirne la logica. In una società di construction management emerse ripetutamente, nelle interviste ai dipendenti, il tema della disparità salariale tra uomini e donne. Il CEO era convinto che l’azienda fosse impegnata nell’equità. Tuttavia, uno studio successivo rivelò una forte disuguaglianza. La causa? La pratica di chiedere ai candidati lo stipendio precedente e costruire da lì la nuova offerta. In questo modo, i pregiudizi del mercato venivano semplicemente reimportati all’interno dell’azienda.

È un esempio perfetto di ciò che può accadere con l’intelligenza artificiale. Se il passato è distorto, un sistema addestrato sul passato può riprodurre e rafforzare tale distorsione, magari con l’apparenza della neutralità matematica. Lo stesso pericolo compare nei sistemi utilizzati in ambito giudiziario, come quelli che stimano recidiva o orientano decisioni di sentencing. Se i dati storici riflettono precedenti pratiche discriminatorie, il risultato rischia di presentare come “previsione oggettiva” ciò che è, in parte, un’eredità del pregiudizio.

La sfida etica, allora, non consiste solo nel rendere la macchina più efficiente. Consiste nel chiederci quali ingiustizie stiamo codificando, quali valori stiamo incorporando e chi sopporterà il costo degli errori.

Agenzia Umana

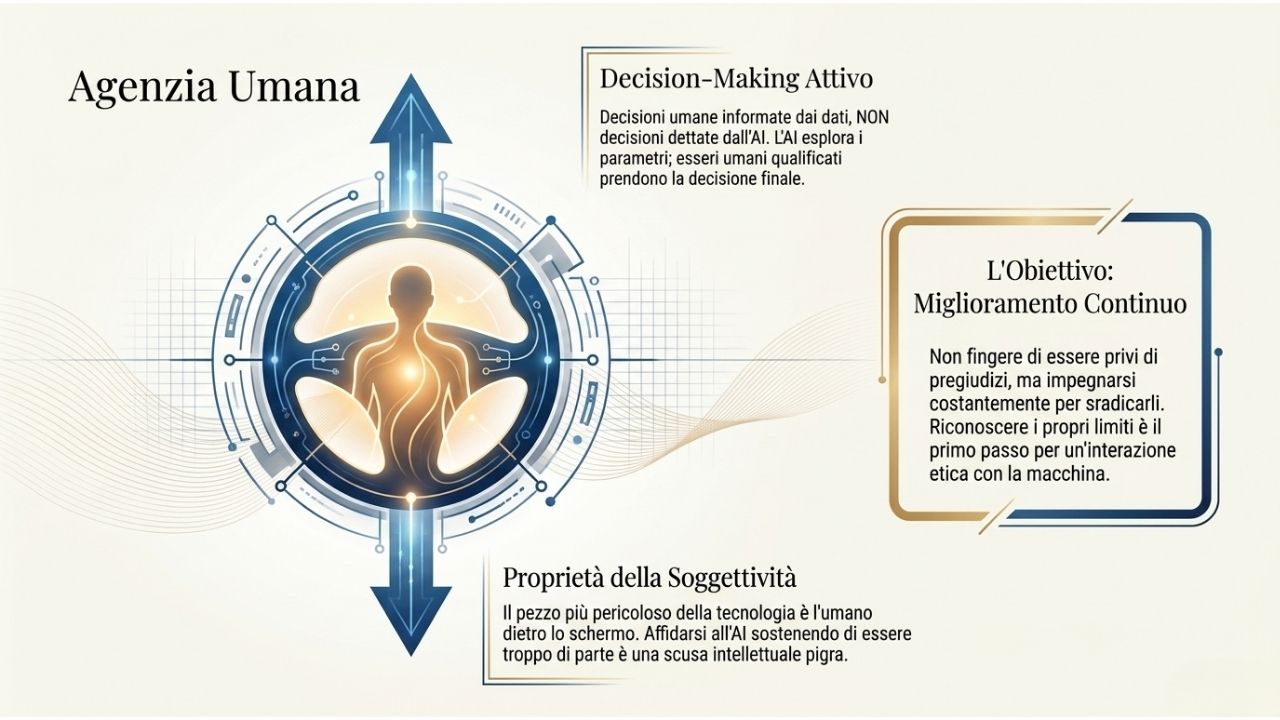

Uno dei contributi più forti emersi nella conversazione è il richiamo all’agenzia umana. La tentazione contemporanea è duplice. Da un lato, attribuiamo all’intelligenza artificiale capacità quasi umane. Dall’altro, siamo tentati di scaricare su di essa il peso delle nostre decisioni, come se una macchina potesse assolverci dalla fatica morale del giudizio.

Cindi Fukami riassume il punto con una battuta memorabile, presa da un’insegna in un’officina: la parte più pericolosa dell’automobile non è il motore, ma “il dado dietro il volante”. Il problema decisivo, anche qui, non è lo strumento in sé, ma l’essere umano che lo usa.

“L’AI è uno strumento, ma lo strumento è usato da esseri umani.”

Farzin Aghdasi sviluppa questa idea in modo ancora più netto. L’intelligenza artificiale è uno scalare, un moltiplicatore di capacità. Una persona orientata alla pace può usarla per promuovere comprensione, cooperazione e bene comune. Una persona orientata alla frode o alla guerra può usarla per rendere più efficiente il danno. Per questo, prima ancora di discutere la macchina, occorre discutere la trasformazione del cuore e della mente di coloro che la impiegano.

Qui l’analogia con l’energia nucleare è utile. Il punto non è che AI e nucleare siano identici, ma che entrambe sono tecnologie ad alto potenziale, capaci di amplificare enormemente la capacità umana. Da qui la necessità di maggiore cooperazione, più regolazione, più maturità morale, più vigilanza collettiva.

Rappresentazione del ruolo centrale dell’essere umano nelle decisioni guidate dall’intelligenza artificiale e nell’etica del miglioramento continuo

Nel linguaggio Bahá’í, questa responsabilità si distribuisce tra tre protagonisti del cambiamento: l’individuo, la comunità e le istituzioni. Ognuno deve accrescere la propria capacità. Il singolo deve formare carattere e discernimento. La comunità deve imparare a consultarsi e a generare conoscenza. Le istituzioni devono creare strutture giuste e affidabili per orientare l’uso della tecnologia.

Allen aggiunge un punto decisivo contro l’idea di “outsourcing morale”. Molti ritengono che, poiché gli esseri umani sono soggettivi e parziali, dovremmo delegare all’intelligenza artificiale decisioni delicate come l’assunzione di personale. Ma questo, osserva, è spesso una scorciatoia intellettuale e morale. Le macchine non sono prive di bias. Anzi, se gli algoritmi sono opachi, potremmo non sapere nemmeno quali bias trasportano.

L’alternativa più sana è un approccio data-informed, non semplicemente data-driven. L’intelligenza artificiale può aiutarci a comprendere schemi, a illuminare opzioni, a rendere più visibili certe tendenze. Ma la decisione finale deve restare nelle mani di esseri umani capaci, coscienti dei propri limiti e impegnati in un processo di miglioramento continuo.

Allen richiama anche una lezione molto bella ricevuta da suo padre: non possiamo garantire di non avere pregiudizi, ma possiamo impegnarci a lavorare su ogni pregiudizio che ci venga mostrato. Questo spirito di umiltà e di progresso è immensamente più fecondo del sogno di una macchina perfetta che decida al posto nostro.

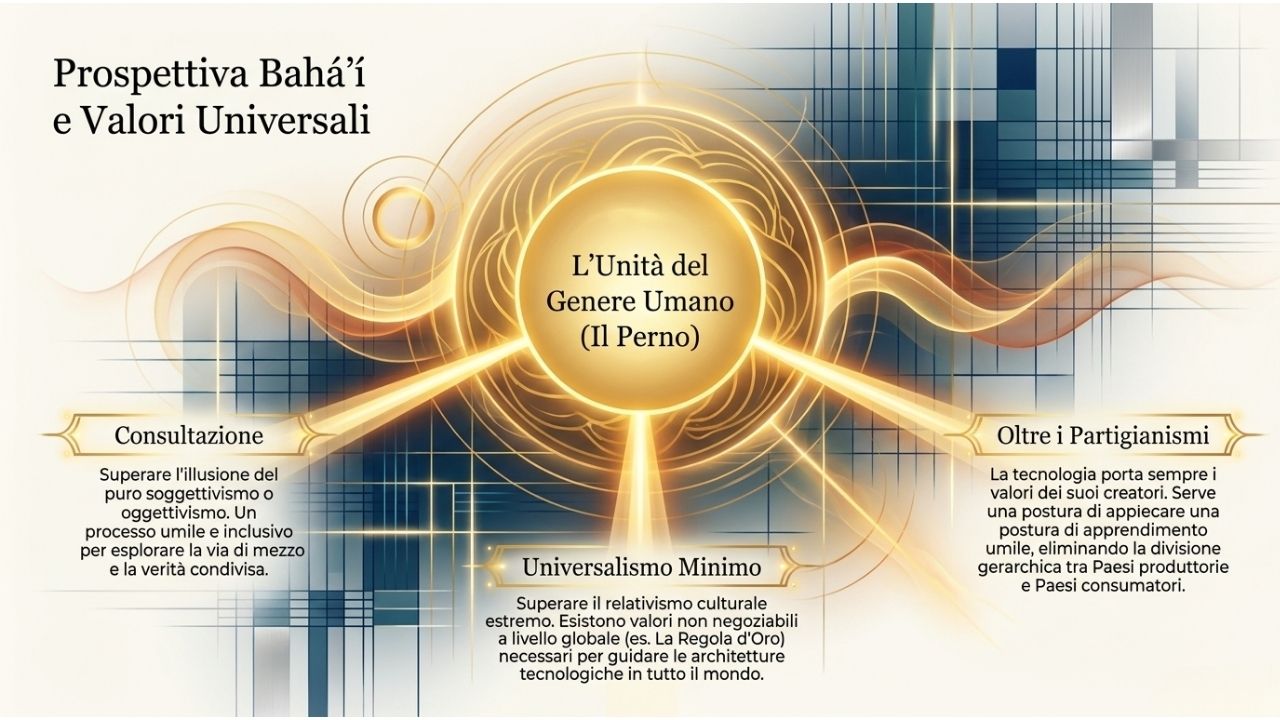

Prospettiva Bahá’í e Valori Universali

Che cosa può offrire la prospettiva Bahá’í al dibattito su intelligenza artificiale ed etica? Non un pacchetto tecnico preconfezionato, né una lista rigida di comandamenti applicabili meccanicamente a ogni nuova invenzione. Offre qualcosa di più profondo: un insieme di principi spirituali universali e un metodo di consultazione e apprendimento capace di guidare le società nell’incontro con le novità del tempo.

Aghdasi sottolinea che i principi coltivati nella comunità Bahá’í non appartengono esclusivamente ai Bahá’í. Sono principi che riguardano tutta l’umanità: la unicità del genere umano, la giustizia, l’equità, la dignità di ogni persona, la necessità di usare la conoscenza per il progresso collettivo. Da questa base, una comunità può affrontare qualsiasi nuova tecnologia, inclusa l’intelligenza artificiale, con una postura umile, investigativa e partecipativa.

Questo approccio rifiuta l’idea che alcuni producano sapere e altri lo consumino passivamente. Tutti possono contribuire alla generazione di conoscenza e alla scoperta dell’uso appropriato di ciò che viene creato. È una visione profondamente diversa da quella che riduce i popoli a “sviluppati” e “in via di sviluppo”, come se il valore e la competenza scorressero in una sola direzione. La visione Bahá’í insiste invece sul fatto che tutta l’umanità è una sola, e che ogni società porta esperienze, intuizioni e capacità preziose.

Visualizzazione della visione Bahá’í che pone l’unità del genere umano al centro dello sviluppo etico dell’intelligenza artificiale

Nel dialogo emerge anche il valore della consultazione. Non basta fare domande. Occorre ascoltare le risposte. E ascoltarle non per manipolare l’altro, ma per comprendere ciò che conta per lui e costruire un terreno comune. La pace, ricorda Fukami, nasce quando ci rendiamo conto di avere molto più in comune di quanto spesso crediamo.

“La pace arriverà quando ci renderemo conto che abbiamo più cose in comune di quante ci siamo lasciati credere.”

Questo porta a un tema complesso ma inevitabile: esistono valori universali, o tutto è relativo alla cultura? La conversazione evita le false dicotomie. Non si tratta di scegliere tra universalismo astratto e relativismo assoluto. Si tratta di riconoscere, come osserva Allen, che probabilmente abbiamo bisogno di entrambi: un quadro di principi generali condivisi e, allo stesso tempo, un serio rispetto per la diversità dei contesti locali.

Navid Pourmokhtari richiama, a questo proposito, l’idea di un “universalismo minimo”, nato nel suo lavoro sul traffico umano globale. Possiamo almeno concordare su alcuni principi di base, come il diritto a non essere sfruttati sessualmente? La risposta emersa è sì. Un nucleo morale comune è necessario.

Fukami aggiunge che esiste almeno un valore presente in ogni cultura: la regola d’oro, la reciprocità. “Fai agli altri ciò che vorresti fosse fatto a te.” È un punto di partenza semplice, ma potentissimo, anche per pensare un’etica dell’intelligenza artificiale.

Da una prospettiva Bahá’í, infine, non si tratta di essere “value neutral”. La neutralità assoluta spesso si rivela una forma mascherata di amoralità. Il compito è piuttosto collaborare per costruire un sistema di valori condiviso, capace di servire l’unità del genere umano.

AI come Strumento per la Pace

Può l’intelligenza artificiale contribuire concretamente alla pace? La risposta emersa nel dialogo è prudente ma reale: sì, può farlo, purché sia guidata da intenzioni rette, da processi inclusivi e da una vigilanza etica costante.

Allen osserva che uno dei contributi più promettenti dell’intelligenza artificiale è la capacità di trattare quantità immense di informazione e di far emergere pattern utili per comprendere fenomeni complessi su scala globale. In un mondo frammentato, saturo di dati e interdipendente, questo può diventare un grande aiuto per la governance, per l’analisi dei conflitti, per l’ascolto diffuso di prospettive molteplici e per l’identificazione di problemi che sfuggono ai nostri strumenti tradizionali.

Fukami richiama persino uno studio svolto nel Regno Unito su gruppi di comunità impegnati a deliberare questioni difficili. In quel caso, mediatori basati su AI sarebbero risultati più efficaci dei mediatori umani nel facilitare l’accordo. È un risultato sorprendente, perché va contro l’intuizione secondo cui un essere umano debba necessariamente essere più capace di mediazione di una macchina. Ma la lezione non è che l’AI “capisca” meglio dell’uomo. Piuttosto, che certi sistemi, se ben addestrati, possono aiutare a ridurre attriti, ordinare argomenti e facilitare processi di convergenza.

Rappresentazione del ruolo dell’intelligenza artificiale nel favorire dialogo, comprensione e costruzione di comunità di pace

Tuttavia, anche qui la domanda decisiva è: come sono addestrati? Con quali dati? Da chi? Per quali fini? Fukami insiste sul fatto che etica non significa soltanto avere norme astratte. Significa anche avere buoni processi per capire cosa sia giusto e cosa sia sbagliato. E quei processi dipendono da chi siede al tavolo.

Se sistemi che incidono sulla vita collettiva vengono progettati quasi esclusivamente da gruppi ristretti, omogenei e socialmente privilegiati, i risultati rifletteranno inevitabilmente quella prospettiva. L’esempio di Google menzionato nella conversazione è eloquente: se a progettare strumenti di selezione sono soprattutto uomini bianchi, non dovrebbe sorprendere che l’output favorisca uomini bianchi. Il problema, allora, non è soltanto tecnico. È di partecipazione, rappresentanza e voce.

Per servire la pace, l’intelligenza artificiale deve essere sviluppata e governata con processi che includano:

- pluralità di prospettive

- consultazione autentica

- attenzione alle conseguenze indirette

- priorità alla sicurezza e all’affidabilità

- impegno verso la giustizia e la dignità umana

Aghdasi aggiunge una riflessione preziosa: la tecnologia non è mai un semplice utensile neutrale che prendiamo e posiamo. Ogni tecnologia porta con sé, in qualche misura, il sistema di valori delle organizzazioni che l’hanno creata. Per questo non basta dire “è solo uno strumento”. Bisogna domandarsi anche quali assunti culturali, economici e morali siano stati incorporati nel suo design.

Da una prospettiva di pace, il cammino non passa dunque per il culto della tecnica, ma per la crescita di “tasche” di armonia, unità e apprendimento. Attraverso consultazione, azione e riflessione, gruppi di persone di buona volontà possono creare spazi sociali che attraggono altri, riducono la settarietà e costruiscono, gradualmente, una cultura di pace. L’intelligenza artificiale può sostenere questo processo. Ma non può sostituirlo.

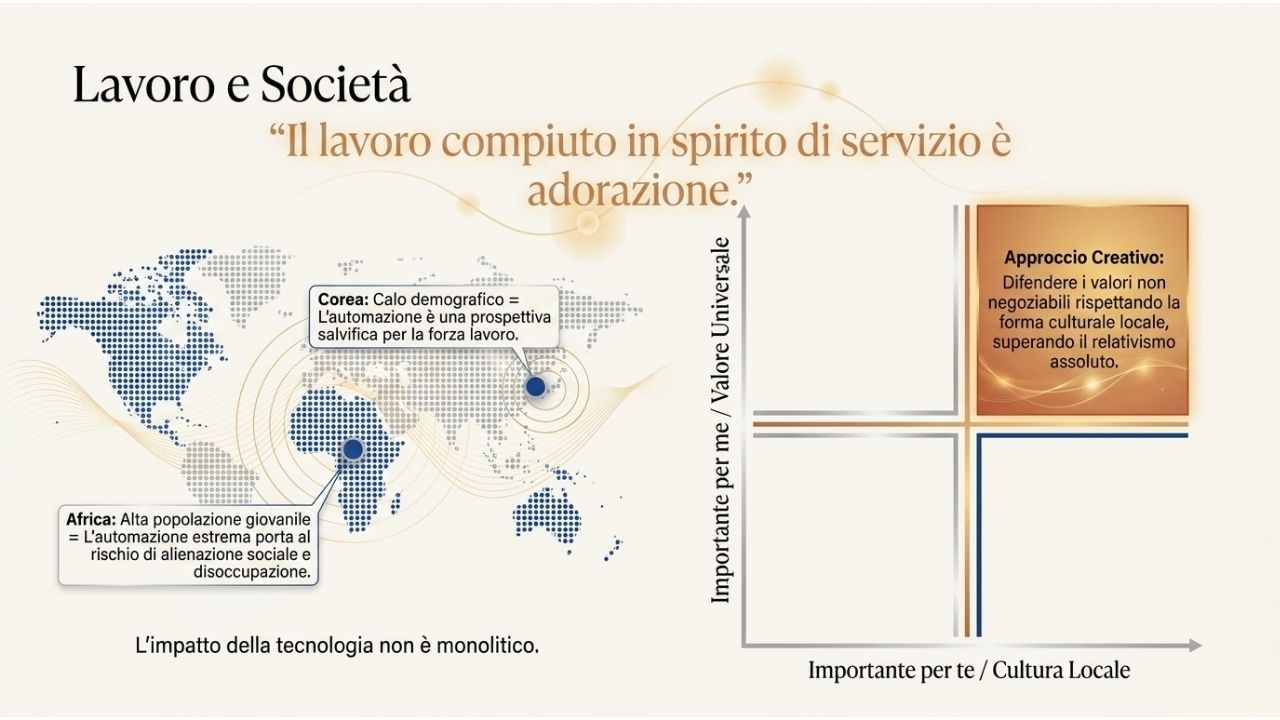

Lavoro e Società

Uno dei campi in cui l’intelligenza artificiale solleva questioni più profonde è il lavoro. Qui il problema non è solo economico. È antropologico e spirituale. Che valore ha il lavoro umano in una società in cui sempre più compiti possono essere automatizzati?

Allen affronta il tema con grande equilibrio. Da un lato, è chiaro che l’intelligenza artificiale può rendere processi più efficienti e ridurre il bisogno di certe mansioni. Dall’altro, nessuna società sana dovrebbe desiderare un futuro in cui la maggioranza delle persone sia esclusa dal contributo produttivo e lasciata senza uno scopo. Nelle Scritture Bahá’í, il lavoro svolto nello spirito del servizio è considerato una forma di adorazione. Nella letteratura manageriale, aggiunge Allen, la meaningfulness of work, il significato del lavoro, è una dimensione centrale del benessere umano.

Questo significa che l’intelligenza artificiale non può essere valutata solo in termini di efficienza. Bisogna chiedersi: che cosa accade alla dignità, alla partecipazione, alla responsabilità e al senso di utilità sociale delle persone?

Qui emerge ancora una volta la necessità di tenere insieme principi universali e realtà locali. In una società con forte calo demografico e scarsità di manodopera, come nel caso evocato della Corea, tecnologie che risparmiano lavoro possono essere particolarmente desiderabili. In un villaggio africano con una popolazione giovane e in età lavorativa, la stessa traiettoria potrebbe risultare molto meno attraente. Dunque non esiste una risposta unica e astratta. Serve consultazione contestuale.

Rappresentazione dell’impatto differenziato dell’intelligenza artificiale sul lavoro e del dialogo tra valori universali e contesti culturali

Allen propone anche un modo pratico per gestire differenze culturali e morali nelle interazioni internazionali. Suggerisce di distinguere ciò che è importante per me e ciò che è importante per l’altro. Se una differenza culturale non è importante per nessuna delle parti, non vale la pena farne una disputa. Se è importante per una parte ma non per l’altra, l’adattamento è relativamente semplice. Il vero terreno creativo è quando un valore importante per me incontra un valore importante per te, e i due sembrano entrare in tensione.

È qui che la consultazione diventa essenziale. Non per annullare le differenze, ma per trovare soluzioni che non umilino nessuno e non costringano nessuno a tradire i propri principi fondamentali. Allen porta un esempio personale: come Bahá’í non beve alcol. In contesti dove il brindisi è culturalmente rilevante, come in Cina, il modo più semplice per evitare attriti non è minimizzare la propria convinzione, ma esprimerla con chiarezza e rispetto. Quando l’altro capisce che si tratta di un principio reale, tende a rispettarlo. Ma questo richiede reciprocità: se voglio che il mio valore sia rispettato, devo essere pronto a rispettare il tuo.

Applicato al mondo del lavoro e della società, tutto questo implica che l’intelligenza artificiale debba essere integrata in modo da:

- preservare il valore umano del lavoro

- rafforzare il servizio, non solo l’efficienza

- tenere conto delle differenze tra contesti sociali

- evitare l’imposizione di un unico modello culturale o economico

- promuovere dignità, partecipazione e giustizia

Alla fine, il cuore della questione resta questo: l’intelligenza artificiale non eliminerà i dilemmi morali della civiltà. Li renderà più urgenti. Per questo la risposta non può essere solo tecnica. Serve una civiltà più matura, più consultiva, più giusta e più cosciente della propria unità.

Come è stato ricordato nel dialogo, viviamo forse ancora come “giganti” sul piano delle capacità tecniche e “nani” sul piano etico. La visione Bahá’í ci invita a colmare proprio questo divario. Se la realtà dell’essere umano è il pensiero, allora il futuro della tecnologia dipenderà, in ultima analisi, dalla qualità morale del pensiero che la guida.

Rappresentazione del ruolo integrato di individuo, comunità e istituzioni nella guida etica dell’intelligenza artificiale

L’intelligenza artificiale può aiutarci molto. Ma la pace, la giustizia e l’unità non saranno prodotte da un algoritmo. Saranno costruite da esseri umani trasformati, da comunità che consultano insieme e da istituzioni capaci di mettere il potere della conoscenza al servizio dell’intera umanità.

Conclusione

La conversazione sull’intelligenza artificiale mette in luce una verità essenziale: non siamo di fronte soltanto a una rivoluzione tecnologica, ma a una prova di maturità etica e spirituale. L’AI non è una mente, non è una coscienza e non è un’autorità morale. È un potente amplificatore. Amplifica ciò che siamo, nel bene e nel male.

Da qui emergono alcune linee fondamentali. Primo, la necessità di comprendere l’AI per ciò che è realmente: uno strumento capace di generare risultati impressionanti, ma non verità autonome. Secondo, l’urgenza di affrontare le sfide etiche – bias, disuguaglianze, uso improprio – non come problemi tecnici isolati, ma come riflessi delle strutture e dei valori delle nostre società. Terzo, il riconoscimento che la tecnologia può contribuire alla pace solo se inserita in processi umani di consultazione, partecipazione e responsabilità condivisa.

In questo quadro, il ruolo dei tre protagonisti del cambiamento diventa decisivo.

L’individuo è chiamato a esercitare la propria agenzia morale: sviluppare discernimento, riconoscere i propri limiti e lavorare attivamente sui propri pregiudizi. Senza questa trasformazione interiore, nessuna tecnologia potrà produrre risultati giusti.

La comunità ha il compito di creare spazi di consultazione autentica, dove la diversità diventa risorsa e non ostacolo. È nella capacità di ascoltare, dialogare e costruire conoscenza condivisa che si pongono le basi per un uso etico dell’intelligenza artificiale.

Le istituzioni, infine, devono garantire orientamento, giustizia e visione a lungo termine. Sono chiamate a governare lo sviluppo tecnologico con saggezza, assicurando che l’AI rimanga uno strumento al servizio dell’umanità e non venga guidata esclusivamente da logiche di profitto o potere.

La prospettiva Bahá’í offre una chiave di lettura unificante: il progresso autentico nasce dall’armonia tra dimensione materiale e spirituale, tra innovazione e valori. L’unità del genere umano, la giustizia e la consultazione non sono ideali astratti, ma criteri concreti per orientare anche le tecnologie più avanzate.

Per comprendere e condividere in modo più approfondito il ruolo dell’individuo, della comunità e delle istituzioni nei processi di trasformazione sociale, si consiglia la lettura dell’articolo “Una fede in azione: come i principi spirituali si traducono in cambiamento sociale”, che esplora in modo più esteso come questi principi possano tradursi in azione concreta.

In definitiva, l’intelligenza artificiale non determinerà il futuro della civiltà. Sarà la qualità delle nostre scelte, delle nostre relazioni e delle nostre istituzioni a farlo. La tecnologia può accelerare il cammino, ma la direzione resta una responsabilità profondamente umana.